👉 Seguici anche sul nostro canale WhatsApp! 🚀

L’esplorazione spaziale moderna dipende sempre di più dalla capacità dei computer di elaborare rapidamente enormi quantità di dati. Ogni sonda, rover o satellite deve infatti essere in grado di prendere decisioni operative, gestire strumenti scientifici, controllare sistemi di navigazione e comunicare con la Terra in ambienti estremi, dove l’assistenza umana immediata è impossibile.

Eppure, nonostante i progressi dell’elettronica terrestre, gran parte dei computer impiegati nei velivoli spaziali non utilizza processori di ultima generazione, che offrono un’architettura più avanzata e la massima potenza di calcolo. Ci si affida invece a modelli relativamente datati, perché nello spazio la priorità assoluta resta l’affidabilità. La velocità di elaborazione passa in secondo piano, l’integrità e la durevolezza sono qualità di gran lunga più importanti.

Prima ancora di avere le prestazioni migliori, gli ingegneri devono assicurarsi che le componenti elettroniche possano sopportare anni di esposizione a radiazioni intense provenienti dal Sole e dallo spazio interstellare, a sbalzi termici estremi, al vuoto spaziale. Condizioni che possono causare errori nei sistemi elettronici, generare blocchi operativi e guasti, forzando il sistema del veicolo spaziale ad attivare il safe mode: una modalità di autoprotezione nella quale vengono disattivate tutte le funzioni non essenziali e il sistema resta sospeso, in attesa di un intervento dei controllori di missione.

Per questa ragione, sviluppare processori e computer di bordo sempre più robusti e potenti rappresenta una delle sfide tecnologiche più importanti nel settore aerospaziale.

La sicurezza e l’affidabilità sono quindi i fattori primari da considerare quando si progetta un computer destinato a operare nello spazio, ma si lavora anche per avere molta più potenza di calcolo a disposizione rispetto a quella impiegata oggi.

Con questa, si avrebbe più elaborazione locale, evitando di spedire i dati sulla Terra per essere processati. Inoltre, snellirebbe e renderebbe più accurata la navigazione, perché il computer potrebbe calcolare e ottimizzare autonomamente sia la rotta che i consumi.

Fornire processori più veloci è importante soprattutto nelle missioni verso lo spazio profondo, in cui è particolarmente utile aggirare i ritardi nei tempi di trasmissione e ricezione dei dati. Pur viaggiando alla velocità della luce, un segnale radio trasmesso dalla Terra necessita comunque di 4-6 ore per raggiungere una sonda che si trova nei pressi di Plutone, a più di 5 miliardi di chilometri da noi. Se si tratta della sonda Voyager 2, ancora attiva nello spazio interstellare a una distanza 21,3 miliardi di chilometri, servono addirittura 19 ore.

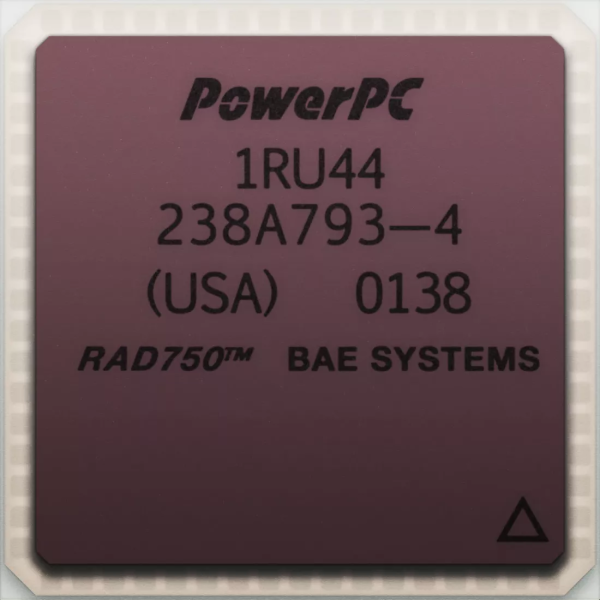

Il microprocessore Rad750 3U montato sul rover Perseverance, tuttora attivo sulla superficie di Marte. Ha una potenza di appena 200 Mhz, paragonabile a un computer di fine anni ’90, ma può resistere a temperature tra -55 °C e +125 °C e a un bombardamento radioattivo di milioni di rad. Lavora con 256 megabyte di Ram e 2 gigabyte di memoria flash (Crediti: Nasa, Bae systems Inc)

Per questo la Nasa sta lavorando al progetto High Performance Spaceflight Computing, in partnership commerciale con Microchip Technology.

L’obiettivo dichiarato è sviluppare un nuovo processore più resistente alle radiazioni e capace di prestazioni computazionali fino a 100 volte superiori rispetto a quelli attualmente utilizzati.

Durante le prime campagne di test, tuttavia, sarebbero emerse indicazioni ancora più promettenti: il chip-prototipo sta offrendo performance anche 500 volte maggiori dei modelli radiation-hardened prodotti fino a oggi.

Il cuore del progetto è l’architettura chiamata system-on-a-chip (Soc), una soluzione che integra in un singolo componente tutti gli elementi principali di un computer: unità centrali di elaborazione, acceleratori computazionali, memoria, interfacce di input/output e sistemi di networking avanzati. Si tratta di caratteristiche già comuni nell’elettronica di consumo, come smartphone e tablet, la sfida ingegneristica consiste nel renderle operative anche in un ambiente come il vuoto spaziale. Non solo, dovranno dimostrare una grande affidabilità, così da garantire il corretto funzionamento anche a miliardi di chilometri dalla Terra, dove è impossibile intervenire per manutenzione o riparazioni.

Per questo motivo si sta sottoponendo il nuovo chip a una lunga serie di test presso il Jet Propulsion Laboratory della Nasa, in California. Le prove includono esposizione a radiazioni, shock meccanici e forti variazioni di temperatura, condizioni che servono a simulare gli ambienti operativi reali delle missioni spaziali. Secondo il project manager Jim Butler, i ricercatori stanno inoltre utilizzando simulazioni di atterraggio basate su dati provenienti da missioni Nasa reali. L’obiettivo è verificare la capacità del processore di gestire grandi volumi di informazioni provenienti dai sensori di navigazione e discesa.

Un altro aspetto particolarmente rilevante del progetto, infine, riguarda l’autonomia e l’indipendenza dei futuri veicoli spaziali. La Nasa prevede infatti che questa nuova generazione di chip possa consentire anche il funzionamento di sistemi di intelligenza artificiale. Un’implementazione fondamentale, che permetterà di reagire in tempo reale a situazioni critiche o complesse, sia aggirando il problema del ritardo delle comunicazioni, che rende impraticabile il controllo diretto dalla Terra, sia vagliando più elementi e variabili rispetto agli algoritmi finora impiegati.

Foto di apertura: un prototipo del nuovo processore sviluppato da Nasa

Crediti: Nasa, Jpl/Caltech